Ervaring is essentieel voor het ontwikkelen van de vaardigheden die nodig zijn om diepgaand leren toe te passen op nieuwe problemen. Een snelle GPU betekent een snelle winst in praktijkervaring door directe feedback. GPU's bevatten meerdere kernen voor parallelle berekeningen. Ze bevatten ook een uitgebreide geheugenbandbreedte om deze informatie gemakkelijk te beheren.

|

Met dit in gedachten proberen we de vraag te beantwoorden: "Wat is de beste grafische kaart voor AI, machine learning en deep learning?"?” door verschillende grafische kaarten te beoordelen die momenteel beschikbaar zijn in 2021. Kaarten beoordeeld:

- AMD RX Vega64

- NVIDIA Tesla V100

- Nvidia Quadro RTX 8000

- GeForce RTX 2080 Ti

- NVIDIA Titan RTX

Hieronder de resultaten:

AMD RX Vega64

Radeon RX Vega 64

Kenmerken

- Releasedatum: 14 augustus 2017

- Vega-architectuur

- PCI Express-interface

- Kloksnelheid: 1247 MHz

- Stream-processors: 4096

- VRAM: 8 GB

- Geheugenbandbreedte: 484 GB/s

Recensie

Als je de NVIDIA GPU's niet leuk vindt, of als je budget je niet toestaat om meer dan $ 500 aan een grafische kaart uit te geven, dan heeft AMD een slim alternatief. Met een behoorlijke hoeveelheid RAM, een snelle geheugenbandbreedte en meer dan genoeg streamprocessors, is AMD's RS Vega 64 erg moeilijk te negeren.

De Vega-architectuur is een upgrade van de vorige RX-kaarten. Qua prestaties ligt dit model dicht bij de GeForce RTX 1080 Ti, aangezien beide modellen een vergelijkbaar VRAM hebben. Bovendien ondersteunt Vega native half-precisie (FP16). De ROCm en TensorFlow werken, maar de software is niet zo volwassen als in NVIDIA grafische kaarten.

Al met al is de Vega 64 een degelijke GPU voor deep learning en AI. Dit model kost ruim onder $500 USD en klaart de klus voor beginners. Voor professionele toepassingen raden we echter aan te kiezen voor een NVIDIA-kaart.

AMD RX Vega 64 Details: Amazon

NVIDIA Tesla V100

Tesla V100

Kenmerken:

- Releasedatum: 7 december 2017

- NVIDIA Volta-architectuur

- PCI-E-interface

- 112 TFLOPS Tensor-prestaties

- 640 tensorkernen

- 5120 NVIDIA CUDA®-kernen

- VRAM: 16 GB

- Geheugenbandbreedte: 900 GB/s

- Compute-API's: CUDA, DirectCompute, OpenCL™, OpenACC®

Recensie:

De NVIDIA Tesla V100 is een kolos en een van de beste grafische kaarten voor AI, machine learning en deep learning. Deze kaart is volledig geoptimaliseerd en wordt geleverd met alle goodies die je hiervoor nodig hebt.

De Tesla V100 wordt geleverd in geheugenconfiguraties van 16 GB en 32 GB. Met veel VRAM, AI-versnelling, hoge geheugenbandbreedte en gespecialiseerde tensor-cores voor diepgaand leren, kunt u er zeker van zijn dat elk trainingsmodel soepel zal verlopen - en in minder tijd. In het bijzonder kan de Tesla V100 125TFLOPS aan deep learning-prestaties leveren voor zowel training als inferentie [3], mogelijk gemaakt door NVIDIA's Volta-architectuur.

NVIDIA Tesla V100-details: Amazon, (1)

Nvidia Quadro RTX 8000

Nvidia Quadro Rtx 8000

Kenmerken:

- Releasedatum: augustus 2018

- Turing-architectuur

- 576 tensorkernen

- CUDA-kernen: 4.608

- VRAM: 48 GB

- Geheugenbandbreedte: 672 GB/s

- 16.3 TFLOPS

- Systeeminterface: PCI-Express

Recensie:

De Quadro RTX 8000 is speciaal gebouwd voor deep learning matrixberekeningen en berekeningen en is een eersteklas grafische kaart. Aangezien deze kaart wordt geleverd met een grote VRAM-capaciteit (48 GB), wordt dit model aanbevolen voor het onderzoeken van extra grote rekenmodellen. Bij gebruik in combinatie met NVLink kan de capaciteit worden verhoogd tot 96 GB VRAM. wat veel is!

Een combinatie van 72 RT- en 576 Tensor-cores voor verbeterde workflows resulteert in meer dan 130 TFLOPS aan prestaties. Vergeleken met de duurste grafische kaart op onze lijst - de Tesla V100 - biedt dit model mogelijk 50 procent meer geheugen en weet het toch minder te kosten. Zelfs met geïnstalleerd geheugen levert dit model uitzonderlijke prestaties bij het werken met grotere batchgroottes op een enkele GPU.

Nogmaals, net als Tesla V100 wordt dit model alleen beperkt door uw prijsdak. Dat gezegd hebbende, als je wilt investeren in de toekomst en in hoogwaardige computers, koop dan een RTX 8000. Wie weet leid jij het onderzoek naar AI. Tesla V100 is gebaseerd op Turing-architectuur waar de V100 is gebaseerd op Volta-architectuur, dus Nvidia Quadro RTX 8000 kan als iets moderner en iets krachtiger worden beschouwd dan de V100.

Nvidia Quadro RTX 8000 Details: Amazon

GeForce RTX 2080 Ti

Geforce RTX 2080 Founders Edition

Kenmerken:

- Releasedatum: 20 september 2018

- Turing GPU-architectuur en het RTX-platform

- Kloksnelheid: 1350 MHz

- CUDA-kernen: 4352

- 11 GB ultrasnel GDDR6-geheugen van de volgende generatie

- Geheugenbandbreedte: 616 GB/s

- Vermogen: 260W

Recensie:

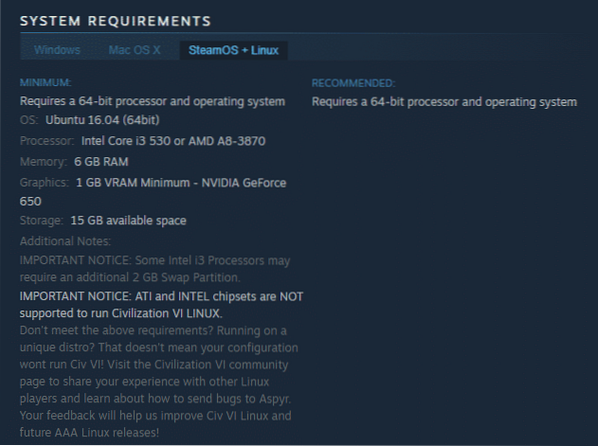

De GeForce RTX 2080 Ti is een budgetoptie die ideaal is voor kleinschalige modelleringsworkloads, in plaats van grootschalige trainingsontwikkelingen. Dit komt omdat het een kleiner GPU-geheugen per kaart heeft (slechts 11 GB). De beperkingen van dit model worden duidelijker bij het trainen van enkele moderne NLP-modellen. Dat betekent echter niet dat deze kaart niet kan concurreren. Het blowerontwerp op de RTX 2080 zorgt voor veel dichtere systeemconfiguraties - tot vier GPU's binnen één werkstation. Bovendien traint dit model neurale netwerken met 80 procent van de snelheden van de Tesla V100. Volgens LambdaLabs' deep learning prestatiebenchmarks, vergeleken met Tesla V100, is de RTX 2080 73% van de snelheid van FP2 en 55% van de snelheid van FP16.

Ondertussen kost dit model bijna 7 keer minder dan een Tesla V100. Zowel qua prijs als qua prestaties is de GeForce RTX 2080 Ti een geweldige GPU voor deep learning en AI-ontwikkeling.

GeForce RTX 2080 Ti-details: Amazon

NVIDIA Titan RTX

NVIDIA Titan RTX-graphics

Kenmerken:

- Releasedatum: 18 december 2018

- Aangedreven door NVIDIA Turing™-architectuur ontworpen voor AI

- 576 Tensor Cores voor AI-versnelling

- 130 teraFLOPS (TFLOPS) voor deep learning-training

- CUDA-kernen: 4608

- VRAM: 24 GB

- Geheugenbandbreedte: 672 GB/s

- Aanbevolen voeding 650 watt

Recensie:

De NVIDIA Titan RTX is een andere mid-range GPU die wordt gebruikt voor complexe deep learning-bewerkingen. De 24 GB VRAM van dit model is voldoende om met de meeste batchgroottes te werken. Als u echter grotere modellen wilt trainen, koppelt u deze kaart aan de NVLink-brug om effectief 48 GB VRAM te hebben. Deze hoeveelheid zou zelfs voldoende zijn voor NLP-modellen met grote transformator. Bovendien zorgt Titan RTX voor full-rate mixed-precision training voor modellen (i.e., FP 16 samen met FP32 accumulatie). Als gevolg hiervan presteert dit model ongeveer 15 tot 20 procent sneller in bewerkingen waarbij Tensor Cores worden gebruikt.

Een beperking van de NVIDIA Titan RTX is het ontwerp met twee ventilatoren. Dit bemoeilijkt complexere systeemconfiguraties omdat het niet in een werkstation kan worden verpakt zonder substantiële aanpassingen aan het koelmechanisme, wat niet wordt aanbevolen.

Over het algemeen is Titan een uitstekende GPU voor alle doeleinden voor zowat elke diepgaande leertaak. Vergeleken met andere grafische kaarten voor algemeen gebruik, is het zeker duur. Daarom wordt dit model niet aanbevolen voor gamers. Desalniettemin zou extra VRAM en prestatieverbetering waarschijnlijk worden gewaardeerd door onderzoekers die complexe deep learning-modellen gebruiken. De prijs van de Titan RTX is aanzienlijk lager dan die van de hierboven getoonde V100 en zou een goede keuze zijn als je budget het niet toestaat dat de V100-prijzen diep leren of je werklast niet meer nodig heeft dan de Titan RTX (zie interessante benchmarks)

NVIDIA Titan RTX-details: Amazon

De beste grafische kaart kiezen voor AI, machine learning en deep learning

AI, machine learning en deep learning-taken verwerken enorm veel gegevens. Deze taken kunnen veel van uw hardware vragen. Hieronder staan de functies waarmee u rekening moet houden voordat u een GPU aanschaft.

kernen

Als eenvoudige vuistregel geldt: hoe groter het aantal kernen, hoe hoger de prestaties van uw systeem. Er moet ook rekening worden gehouden met het aantal kernen, vooral als u te maken hebt met een grote hoeveelheid gegevens. NVIDIA heeft zijn cores CUDA genoemd, terwijl AMD hun cores stream-processors noemt. Ga voor het hoogste aantal verwerkingskernen dat uw budget toelaat.

Rekenkracht

De verwerkingskracht van een GPU hangt af van het aantal kernen in het systeem vermenigvuldigd met de kloksnelheden waarmee u de kernen uitvoert. Hoe hoger de snelheid en hoe hoger het aantal cores, hoe hoger de verwerkingskracht waarmee uw GPU gegevens kan berekenen. Dit bepaalt ook hoe snel uw systeem een taak zal uitvoeren.

VRAM

Video RAM, of VRAM, is een meting van de hoeveelheid gegevens die uw systeem tegelijk kan verwerken. Een hogere VRAM is van vitaal belang als u met verschillende Computer Vision-modellen werkt of CV Kaggle-wedstrijden uitvoert. VRAM is niet zo belangrijk voor NLP, of voor het werken met andere categorische gegevens.

Geheugenbandbreedte

De geheugenbandbreedte is de snelheid waarmee gegevens worden gelezen of opgeslagen in het geheugen. In eenvoudige bewoordingen is het de snelheid van de VRAM. Gemeten in GB/s betekent meer geheugenbandbreedte dat de kaart meer gegevens kan opnemen in minder tijd, wat zich vertaalt in een snellere werking.

Koeling

GPU-temperatuur kan een belangrijk knelpunt zijn als het gaat om prestaties. Moderne GPU's verhogen hun snelheid tot een maximum tijdens het uitvoeren van een algoritme. Maar zodra een bepaalde temperatuurdrempel wordt bereikt, verlaagt de GPU de verwerkingssnelheid om te beschermen tegen oververhitting.

Het ontwerp van de ventilatorventilator voor luchtkoelers duwt lucht buiten het systeem, terwijl de ventilatoren zonder ventilator lucht naar binnen zuigen. In architectuur waar meerdere GPU's naast elkaar worden geplaatst, zullen niet-blower-fans meer opwarmen. Als u luchtkoeling gebruikt in een opstelling met 3 tot 4 GPU's, vermijd dan niet-blazende ventilatoren.

Waterkoeling is een andere optie. Hoewel duur, is deze methode veel stiller en zorgt ervoor dat zelfs de meest krachtige GPU-configuraties koel blijven tijdens het gebruik.

Conclusie

Voor de meeste gebruikers die op zoek zijn naar diepgaand leren, bieden de RTX 2080 Ti of de Titan RTX de meeste waar voor hun geld. Het enige nadeel van de RTX 2080 Ti is een beperkte 11 GB VRAM-grootte. Door te trainen met grotere batchgroottes kunnen modellen sneller en veel nauwkeuriger trainen, wat de gebruiker veel tijd bespaart. Dit kan alleen als je Quadro GPU's of een TITAN RTX . hebt. Door gebruik te maken van halve precisie (FP16) passen modellen in de GPU's met onvoldoende VRAM-grootte [2]. Voor meer gevorderde gebruikers moet u echter investeren in Tesla V100. Dat is onze beste keuze voor de beste grafische kaart voor AI, machine learning en deep learning. Dat is alles voor dit artikel. We hopen dat je het leuk vond. Tot de volgende keer!

Referenties

- Beste GPU's voor AI, machine learning en deep learning in 2020

- Beste GPU voor diep leren in 2020

- NVIDIA AI INFERENCE PLATFORM: gigantische sprongen in prestaties en efficiëntie voor AI-services, van het datacenter tot de rand van het netwerk

- NVIDIA V100 TENSOR CORE GPU

- Titan RTX Deep Learning-benchmarks

Phenquestions

Phenquestions